本系列文章部分內容由AI產生,最後皆有通過人工確認內容及潤稿。

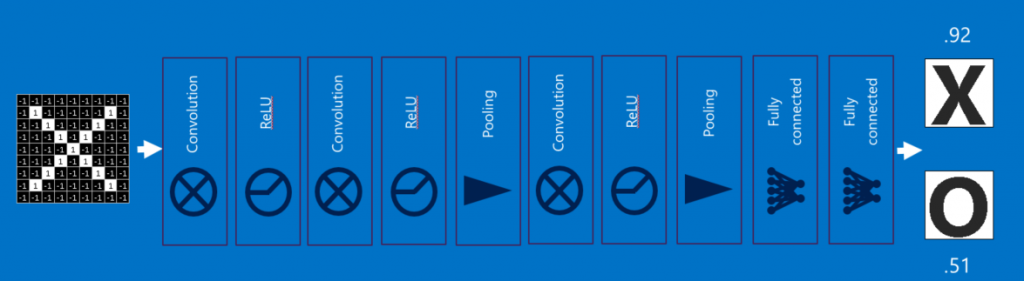

在前三天的學習中,我們深入了解了人工神經網絡的基本原理和訓練方法。然而,傳統的多層感知器(MLP)在處理高維度、結構化數據(如圖像)時存在局限性。今天,我們將探討專為處理圖像和視頻等時空數據而設計的卷積神經網絡(Convolutional Neural Networks,CNN)。CNN在計算機視覺領域取得了巨大的成功,是實現AI換臉技術的關鍵組件之一。

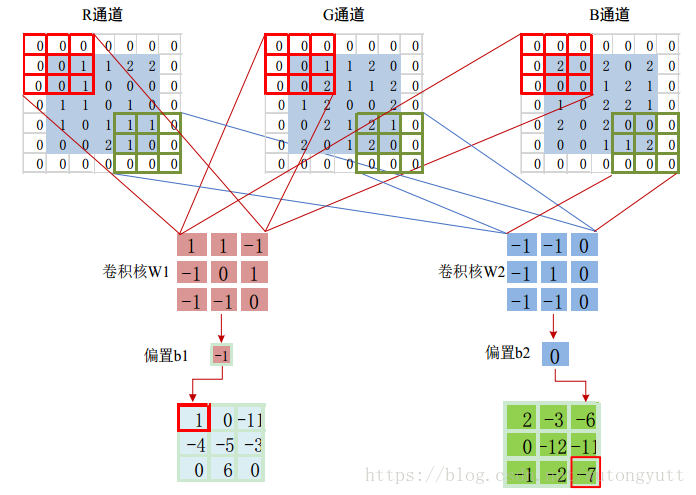

卷積層是CNN的核心,用於提取輸入數據的局部特徵。

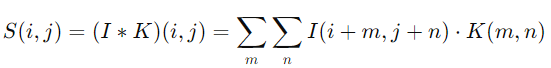

卷積計算公式:

對於輸入圖像𝐼和卷積核(濾波器)𝐾,卷積操作定義為:

卷積操作後得到的輸出稱為特徵圖,反映了輸入數據在某種模式下的響應。

圖2 卷積核在輸入圖像上滑動,計算卷積結果。

在卷積層之後,通常會應用非線性激活函數,如ReLU、Leaky ReLU等,為模型引入非線性能力。

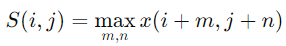

-

-

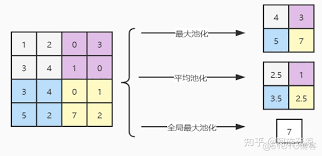

圖3 最大池化和平均池化在特徵圖上進行降維。

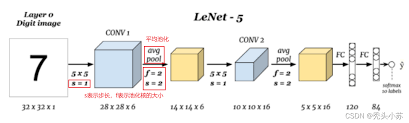

在經過多層卷積和池化後,CNN通常會在最後加入一個或多個全連接層,用於將提取的特徵映射到最終的分類或回歸結果。

在AI換臉技術中,CNN扮演了關鍵角色:

通過今天的學習,我們深入了解了卷積神經網絡的基本結構和原理,以及它在圖像處理中的廣泛應用。CNN是計算機視覺領域的核心模型,也是實現AI換臉技術的重要工具。在接下來的課程中,我們將進一步探討生成式模型和具體的換臉技術實現。

那我們就明天見了!